在AI系统中加入道德判断能力是一个复杂但至关重要的任务,它要求开发者在设计系统时充分考虑道德和伦理原则。以下是一些关键步骤和方法,用于在AI系统中加入道德判断能力:

一、明确道德准则和原则

制定道德准则:首先,需要明确AI系统应遵循的道德准则和原则。这些准则应基于广泛接受的伦理理论,如尊重人权、保护隐私、避免偏见和歧视等。

融入价值观:将人类的价值观融入AI系统的设计中,确保AI系统在决策过程中能够体现这些价值观。例如,可以强调公正性、诚实性和责任等道德原则。

二、开发道德判断算法

基于规则的算法:根据道德准则和原则编写一系列的规则,通过逻辑推理来评估不同行为的道德性。这种方法简单直接,但可能难以处理复杂的道德冲突。

基于机器学习的算法:利用机器学习技术,通过训练AI系统来识别和理解道德决策模式。这可以通过分析大量的道德决策案例、道德规范文献以及专家意见来实现。机器学习算法能够处理更复杂的道德问题,但可能需要大量的训练数据和计算资源。

混合方法:结合基于规则和基于机器学习的方法,以提供更全面和准确的道德判断。例如,可以使用规则来定义基本的道德框架,然后使用机器学习算法来优化和调整决策过程。

三、确保透明度和可解释性

提高算法透明度:使AI系统的道德判断算法具有透明度,以便用户能够理解和信任其决策过程。这可以通过提供详细的决策路径、解释决策背后的逻辑和依据来实现。

可解释性:确保AI系统的决策结果能够被人类所理解。当AI系统面临道德冲突时,应能够向用户解释其决策的依据和理由。

四、建立伦理审查和反馈机制

伦理审查:在AI系统部署之前,进行伦理审查以评估其道德风险和潜在影响。这可以确保AI系统的设计和应用符合道德准则和原则。

反馈机制:建立用户反馈机制,以便收集用户对AI系统道德判断结果的意见和建议。这有助于不断改进和优化AI系统的道德判断能力。

五、持续更新和优化

数据更新:随着道德规范和原则的不断变化,需要定期更新AI系统的训练数据和算法模型,以确保其道德判断能力与时俱进。

算法优化:通过不断的测试和验证,优化AI系统的道德判断算法,提高其准确性和可靠性。

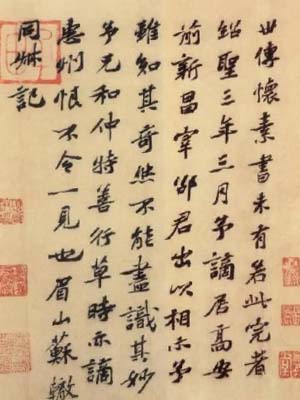

六、参考高权威性来源

在设计和实现AI系统的道德判断能力时,应参考高权威性来源的信息,如国际伦理准则、专业机构的研究报告和学术论文等。这些来源提供了关于道德和伦理问题的深入分析和指导,有助于确保AI系统的道德判断能力具有广泛的社会认可度和可信度。

通过以上步骤和方法,可以在AI系统中加入道德判断能力,使其在面对复杂的道德问题时能够做出符合道德准则和原则的决策。这将有助于推动AI技术的健康发展,并促进人类社会的福祉和进步。

- 上一篇: 如何制定机器道德的准则和规范呢

- 下一篇: 如何在技术上确保AI系统的安全性、可靠性和可解释性

发布评论